ナレッジNEW

ニューラルネットワークとは?仕組みやモデルの種類、学習方法を解説

目次

ニューラルネットワークは現在のAIに用いられる中心的な技術ですが、どのように情報を処理し学習しているのかが直感的に理解しづらいところがあります。

この記事では、数式やコードに深入りし過ぎず、概念として把握しておきたいポイントを整理して解説します。画像や文章の分析で活用されている理由や、学習が進む過程を段階的に説明し、基礎理解の足がかりとなる内容をまとめました。

【初心者向け】ニューラルネットワークとは

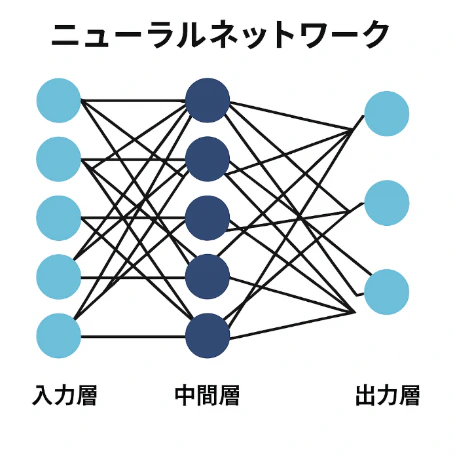

ニューラルネットワークは、脳の仕組みであるニューロンが結び付いて構成されるネットワークを模擬した技術です。結び付いている各々のニューロンが多くの入力を受け取りながら、その中に潜むパターンを段階的に整理していく仕組みであるとも言えます。アルゴリズムを人が設計しなくても、ニューロン間でデータのやりとりを重ねていく中で「重要な部分」を見つけていきます(図表1)。

例えるなら、初めはぼんやりした輪郭しか見えない写真を、層を通過するごとに少しずつシャープにしていくイメージです。画像や文章のような複雑なデータを扱える理由は、この段階的に特徴を抽出する性質にあります。

基本的な「データの中の規則を自動でつかむ仕組み」

ニューラルネットワークは、たくさんの例を見ながら「どの入力が結果に影響しているか」を調整していきます。

正解とのずれを確認し、内部のパラメータを少しずつ修正することで、複雑な関係も徐々に捉えられるようになります。試行を重ねて最適な状態へ近づけていく仕組みです。

次項でさらに詳しく解説します。

ニューラルネットワークの仕組み

ニューラルネットワークは、層(レイヤー)になったノード(ニューロン)が段階的に計算を行う構造を持ちます。

各ノードでは、入力に重みを掛け合わせ、バイアスを加えた結果を次の層へ渡します。こうした単純な計算を積み重ねることで、複雑なデータ構造にも対応できるようになります。

入力層ではデータを受け取り、途中にある隠れ層で特徴が少しずつ整理されます。画像ならエッジのような素朴な特徴から形状へとつながり、文章なら単語の関係性や文脈へと変換されます。

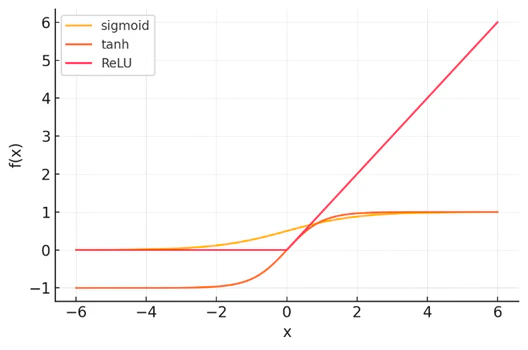

計算の中心となるのが重みとバイアスで、学習はこれらの値を修正していく過程です。さらに、各ノードには活性化関数があり、線形計算だけでは表現できない関係性を扱えるようにします。代表的なReLUは深い層でも扱いやすく、多くのモデルで使われています(図表2)。

ニューラルネットワークの学習方法

ニューラルネットワークは、予測と正解の差を測り、その差を減らす方向へ内部の値を調整するという流れで学習します。

基準となる損失関数は、回帰では平均二乗誤差、分類では交差エントロピーなどが使われ、モデルはこの値を小さくするように更新を重ねます。

損失を減らすための基本手法が勾配降下法です。損失関数の勾配は「どの方向へ動けば損失が減るか」を示し、更新幅は学習率で調整します。学習率が大きいと不安定になり、小さいと進みが遅くなるため、適切に設定する必要があります。

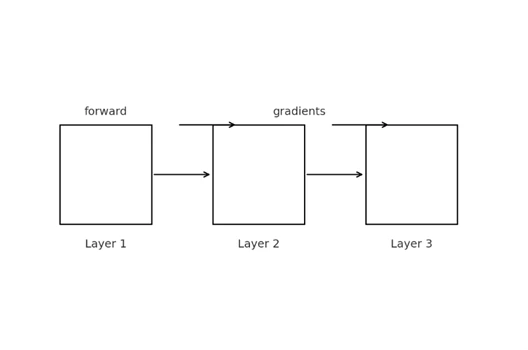

勾配の計算には誤差逆伝播(バックプロパゲーション)が用いられます。損失から各層に誤差をさかのぼらせ、連鎖律を使って効率良く勾配を求める方法で、深いネットワークでも整理された形で計算できます(図表3)。

学習の進み具合はエポック数で管理し、訓練データと検証データの損失を比較することで過学習の兆候を確認します。学習曲線の観察と正則化の組み合わせが、適切なモデル調整の判断材料となります。

ニューラルネットワークの種類と具体例

ニューラルネットワークにはさまざまな構造があり、扱うデータや目的に応じて使い分けられています。画像・文章・音声・時系列など、データの性質によって得意なモデルが変わる点が特徴です。以下に主な特徴について説明します。

シンプルな形のネットワーク(MLP)

MLPは入力層・隠れ層・出力層を直線的につないだ最も基礎的な構造です。層を増やすことで表現できるパターンが広がり、表形式データの分類や数値予測など、幅広い場面で使われています。ニューラルネットワークの仕組みを理解する上での基本形です。

画像を見分けるのが得意なタイプ(CNN)

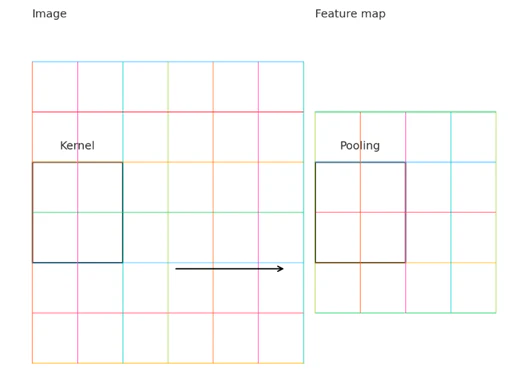

CNNは画像に含まれる局所的なパターンを抽出する計算を繰り返しながら特徴を整理します(図表4)。エッジから形状、物体といった順序で情報を捉えられる点が強みで、分類・検出・セグメンテーションなどのタスクで活用されています。

文章や時系列データが得意なタイプ(RNN・LSTM・GRU)

RNNは系列データの時間的なつながりを扱うモデルで、文章やセンサ値の変化を扱う場面に適しています。しかし長い系列では勾配が弱くなるため、LSTMやGRUのようにゲート機構を持つ構造が広く利用されています。

言葉の意味を深く理解するタイプ(Transformer)

Transformerは自己注意(Multi-Head-Attention)という仕組みで、離れた位置の単語同士の関係も同時に扱えます。並列計算と相性が良く、大規模言語モデルの基盤になっている構造です。文章だけでなく画像や音声にも応用が広がっています。

画像や音声を作り出すのが得意なタイプ(GAN・Diffusion)

GANは生成モデルの代表例で、互いに競い合う2つのネットワークが新しい画像などを生成します。Diffusionはノイズの除去を段階的に行う生成方法で、近年の高品質画像生成モデルで採用されています。

試行錯誤しながら学ぶタイプ(強化学習)

強化学習では、行動と結果を繰り返し、得られた報酬を基に行動方針を調整します。ゲーム攻略やロボット制御のように、環境と対話しながら最適な行動を探すタスクに向いています。

人や物のつながりを扱うのが得意なタイプ(GNN)

GNNはノードとエッジで表されるグラフ構造を扱うモデルです。

人のつながり、商品の関連性、分子構造といった関係データを扱う場面で利用されます。近傍のノードから情報を受け取りながら表現を更新する仕組みが特徴です。

音声や音の特徴をつかむのが得意なタイプ(音響モデル)

音響モデルは、周波数成分や時間変化を捉え、音声認識や音源分類に使われます。CNNやRNN、Transformerなどを組み合わせる形で活用されることも多く、音の構造を多面的に捉えるための基盤となるモデルです。

ニューラルネットワークの実装の流れ

ニューラルネットワークを動かすには、データの準備からモデルの評価までを順序立てて進めます。基本的な流れは次のとおりです。

- データの準備(収集・前処理・分割)

- モデルの定義(層構造・活性化関数の設定)

- 損失関数と最適化手法の指定

- 学習(訓練データでの更新)

- 評価(検証データでの性能確認)

- 改良(ハイパーパラメータや構造の調整)

最小実装の流れ

最もシンプルな実装では、データの分割、モデル定義、学習、評価の4要素を押さえるだけで動かせます。分類問題を想定した例を挙げます。

# 擬似コード(PyTorch風)

for x, y in train_loader:

y_pred = model(x)

loss = criterion(y_pred, y)

optimizer.zero_grad()

loss.backward() # 逆伝播

optimizer.step() # 勾配降下 この短い処理の中で、誤差計算・逆伝播・更新が完結しています。損失の推移を確認し、収束の有無を把握するところが最初のチェックポイントです。

実務の現場で重要な工夫

実務では、単にモデルを動かすだけでは不十分で、安定性や再現性の確保が欠かせません。どのようなことを行うのか、その狙いを含め、図表5に示します。

項目 | ねらい |

|---|---|

シードの固定化による初期乱数の固定化 | 実験の再現性を確保するための基盤 |

ログ保存と可視化 | 学習過程の変動を把握する |

正則化(Dropout、L2など) | 過学習の抑制 |

学習率スケジューリング | 更新の停滞や発散を避ける |

データ拡張 | 特徴の多様化による汎化性能の改善 |

図表5: ニューラルネットワークを用いる上での工夫

こうした工夫は、モデル性能の安定に直結します。

実務での注意点

実装後の判断には、データの癖と評価方法の適切さが影響します。特に注意したいのは以下の事項です。

データリークの検出

訓練と検証に同じ情報が混入すると、評価がゆがみます。IDごとの分割や時間順の保持が必要なケースもあります。

クラス不均衡への対応

分類問題では、少数クラスを正しく扱えているかを再現率やF1で確認します。

前処理の一貫性

学習時と推論時で異なる処理を行うと性能が大きく変わるため、パイプラインを統一します。

学習曲線の継続的確認

訓練損失と検証損失の乖離は過学習の兆候です。早期終了の導入が有効な場面もあります。

ニューラルネットワークの理解を深めるために

ニューラルネットワークは、層構造による特徴抽出、損失と勾配を用いた学習、そして目的に応じた多様なモデル群によって成り立っています。

画像・文章・音声など、扱うデータが変われば有効な構造も異なり、実装では前処理や学習率の調整、評価方法の設計が欠かせません。

実務では再現性の確保やデータ分割の工夫が品質に影響します。仕組みと種類、学習の流れを押さえることで、幅広い応用へ視点を広げられるでしょう。

■参考文献・出典■

- Ian Goodfellow, Yoshua Bengio, Aaron Courville, Deep Learning, MIT Press, 2016

- Learning representations by back-propagating errors|Nature

- Gradient-based learning applied to document recognition | IEEE Journals & Magazine | IEEE Xplore

- Long Short-Term Memory | MIT Press Journals & Magazine | IEEE Xplore

- [1706.03762] Attention Is All You Need|arxiv

この記事は面白かったですか?

今後の改善の参考にさせていただきます!

-portrait.webp)