Technical Information

セキュリティシステムの未来展望 ~AIで変わるセキュリティの概念~

私は長らく事業会社で情報通信技術の研究開発に携わり、現在はベリサーブで未来志向のコンサルティング技術の開発を統括しています。本講演では、これまでに私が培った知見に基づくセキュリティシステムの未来予測についてお話しします。独自の考察ですので、おそらくネットで検索しても簡単に見つかる情報ではないと考えていますが、何かしら皆様の参考になりましたら幸いです。

※この記事は、『ベリサーブ アカデミック イニシアティブ 2021』の講演内容を基にした内容です。

株式会社ベリサーブ

ソリューション事業部

岡田 秀二

ITがもたらす社会構造の変革

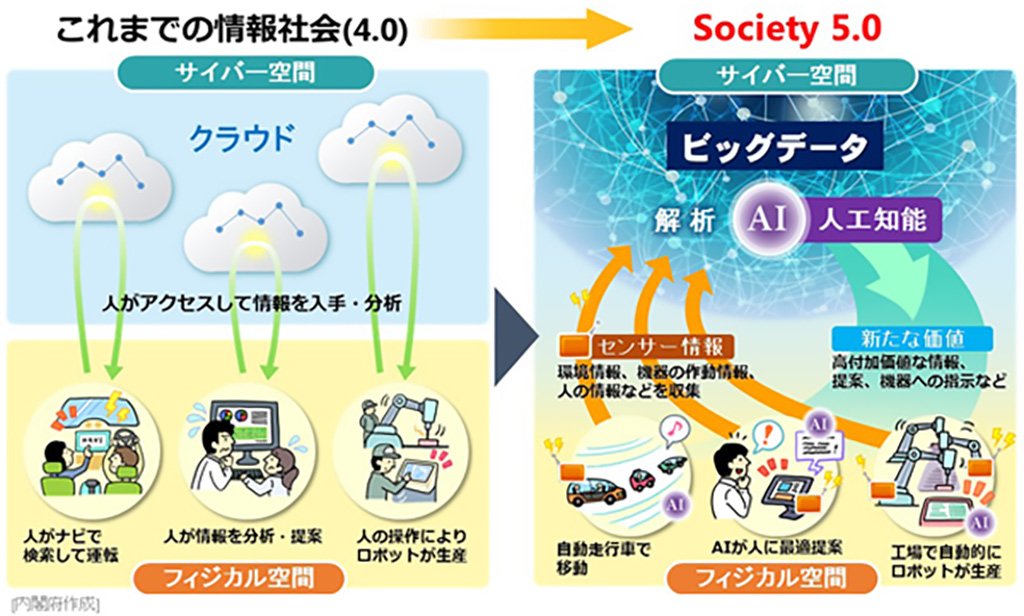

図表1は、「Society 5.0」という、日本政府が目指す未来社会のコンセプトを表したものです。フィジカル空間とサイバー空間がデータやAIを介して高度に融合し、経済の発展と社会的課題の解決を両立する新たな社会を提唱しています。こうした社会構造の変革は、そこに暮らす人々の社会観念も大きく変えていくことが予想されます。

出典:https://www8.cao.go.jp/cstp/society5_0/society5_0-1.pdf

まず、プライバシーはフィジカル空間とサイバー空間で二面性を持つようになり、個人と集団の両方の軸で意識する必要が出てきます。また、両空間のAIによる有機的な連動が一人歩きして不慮の事故を起こさないよう、監視することが求められます。法規制の範囲と対象が拡大する動きもあります。すでにEUではAIの倫理面を考慮した規制案が提示され、日本でも総務省や経済産業省によるAIガバナンスに関する検討会においてガイドラインの整備が進められています。

社会構造の変化に即応する新しいセキュリティ概念

社会構造の変化は、セキュリティの概念にも影響を及ぼします。組織の情報資産を守るための仕組みである情報セキュリティマネジメントシステム(ISMS)では、C・I・A=機密性、完全性、可用性をセキュリティの3要素と定義しています。しかし、AIが実装された社会では安全性や倫理性に対するリスクが高まると考えられ、S・H・I・E・L・D=安全性、健康、情報、知的財産権、倫理性、合法性、企業・国家防衛が、今後意識すべき領域となります(図表2)。ここでは従来のC・I・Aは「情報」に含まれます。

新たな脅威に対抗するためのセキュリティシステムとは

AIの実装に伴う新たな脅威の台頭

サイバー空間をつかさどる頭脳となるのがAIなら、攻撃側もAIを使うことが予想され、セキュリティの攻防はAI対AIの構図になる可能性があります。従来のようにマルウェアや不正アクセスを仕掛けるだけでなく、AIに対してニセの指示を出す、AIが参照するナレッジベースを書き換えるなど、AIの正常な動作を妨害する攻撃が発生することが考えられます。

さらに、AIの特性がもたらす脅威も懸念されます。AIの誤判断や法規制に違反する挙動などに対処するには、AIアプリの動作を監視する必要が出てきますが、画一的なロジックでは難しいため、ここでもAIでAIを監視することになるでしょう。

将来のセキュリティシステムに求められる機能

AIを使うことでサイバー攻撃が高度化・巧妙化するなら、守る側もAIを使い先回りして対策を講じる必要があります。今後は、攻撃はもはや防御できないという前提に立ち、侵害時に被害を最小限に抑え、早期復旧が可能な仕組みを構築しておかなくてはなりません。現在のセキュリティ対策の分野でもすでにAIの導入は進んでいますが(図表3)、これらは不正や脆弱性(セキュリティ上の欠陥)の検知に重点を置いており、機能領域と学習レベルの深さが限定された、いわば用途特化型の弱いAIと言えます。

将来のセキュリティシステムも用途特化型であることに変わりはないでしょうが、より深い学習能力を備えた強いAIとなり、予測・防御・

検知・分析・検証・復旧といった機能が自動化されると考えられます(図表4)。

具体的には、次のような流れになると想定されます。まず、AIは機械学習によって脅威を予測し、防御のための対策を導き出します。機械学習により導出したルールに基づく条件と実際に起きた事象を照合することで異常を検知します。その異常の原因を突き止めて、それを封じ込めるための対策を提示するのが分析です。対策の実行前にはシミュレーションを行い、対策を講じた後に影響がないことを検証します。このときの検証は、フィジカル空間と等価の仕組みをサイバー空間に実現した「デジタルツイン」領域で行います。そこで問題がなければ、暫定対応を実行すると同時に、防御プロセスへのフィードバックを自動的に行います。これが復旧です。

現在、製品化されているセキュリティツールは、それぞれ対応する機能領域(防御、検知、対応など)が分かれています。しかし近年では、どの製品も対応領域を徐々に拡大する傾向にあります。そのため、例えば検知領域の製品が防御機能も備えるなど、互いの得意領域を侵食し合うケースが生じています。従来の製品が部分最適で開発されているとすれば、今後は予測から対応までの一連の流れを念頭に、全体最適化を目指す設計を行うことで、運用の効率を高めることができます。

脅威インテリジェンスの高度化に必要なこと

脅威インテリジェンスとは、攻撃者や犯罪者グループに関する情報や攻撃の手口など、サイバー攻撃に関するさまざまな情報を収集・分析して蓄積した知見を指します。これを高度化するには、収集から対策までの一連のプロセスを自動化し、人の介入を極小化することがポイントになります(図表5)。

まず収集フェーズでは、外部の組織と連携して脅威関連情報を取得します。国内外の法規制や地政学的リスクなどに関する脅威を自ら予測するために、ディープラーニングによるAIの個別チューニングも必要です。次の加工フェーズでは、取得したデータのコンテキストと自社環境との関連性を分析した上で、使える形態に成形します。そのデータを使って、分析フェーズで自社環境にどんな影響があるかを予測した後、対策

フェーズで原因と対策の紐付けを推論し、リスク低減につなげていきます。

AIの長所と短所

AIは特定領域に強く、膨大な情報からの学習能力と推論スピードは人間の比ではありません。また、人間では考えつかないような未知の脅威を予測できるのではないかとの期待もあります。一方で、AIを使うことで責任の所在が曖昧になることが懸念されています。また、AIのロジックがブラックボックスであるために、導き出された結果を人間が検証する際に根拠となる情報が得られず、判断に苦慮する可能性があります。そもそもAIを100%信用してよいのかということも、大きな課題となるでしょう。AIの長所を活かしつつ、短所を補完するための仕組みを整備していく必要があります。

将来的なセキュリティシステムのトポロジー

図表6は、将来のセキュリティシステムのトポロジー(階層化した処理分散の構成)の例です。階層の分類にはさまざまなケースが考えられますが、例えば1番下のZoneの枠には会社の支社が、中間のRegionの枠には本社があり、Centerには国家組織が位置するといった切り分けで考えると分かりやすいでしょう。

このように階層化するのは2つの理由があります。1つは国内外の法規制やITの進展動向、地政学的リスク、倫理性などに関する判断を末端部分が単独で行うべきではないということです。もう1つは、AIの膨大な処理のためのキャパシティを末端の個々に持たせることは、処理能力やパフォーマンスの点で現実的ではないということです。AIの処理を行う上位層にのみ、高い性能を持つマシンを配置し、下位層では比較的負荷の低い検知や対応に注力します。このように、処理を分散することによって全体の効率性が高まり、さらに大局的な判断を上位層に委ねることで配下との整合性が確保できます。

AIによる脅威予測モデル

図表7は、将来のセキュリティシステムで重要な機能の1つとなる、AIによる脅威予測モデルの例です。国内外の法規制やITの進展動向、地政学的リスクなどをAIに学習させることで、実際のビジネスへの影響を予測して脅威を推定します。

ここでの脅威は組織や人、情報資産に害を及ぼす事象を、脆弱性はガバナンスや業務プロセス、ITの弱点などをそれぞれ指します。脅威の大きさと脆弱性の度合いによって、リスク領域の特定とそのレベルを算定することができます。ここで得られたリスク情報は、後工程での脅威対策の内容と強度の検討に利用されます。

脅威の予測は、自社環境・外部環境・時間の3軸で考えます。自社環境はガバナンスや業務プロセス、IT環境など、外部環境は国内外の法規制やITの進展動向、社会構造などが該当します。これらが時間の経過とともにどのように変わっていくか分析しつつ、未来の潜在脅威を予測します。

AIによるCSIRTの高度化

実際にインシデントが発生した際には、CSIRT※1 (シーサート、Computer Security Incident Response Team)の出番となります。ここでも

AIを活用したワークフローの自動化により、検知から対応、復旧に至るリードタイムの縮小が可能になります。ただし、全てをAIに頼るのはリスクもあります。そのため、例えば検知や情報把握までをAIが実行し、その結果の検証と最終決定は人間が判断するといった検討が必要です。意思決定には、判定対象の重要度によって承認者を分けるといった階層化も必要になってきます。その後はインシデントへの暫定対応の実行と並行して、脅威予測や防御プロセスに自動フィードバックする機能を実装することで、CSIRT全体の対応フローの高速化を図ります(図表8)。

※1:コンピューターやネットワークで発生するセキュリティ上のインシデント(問題、事故)が生じた際に対応する専門チームのこと

※2:日本語ではセキュリティ情報イベント管理。ネットワーク機器やサーバなど複数の機器が生成するログを一元的に管理・分析し、脅威の兆候をいち早く検知する仕組み

※3:User and Entity Behavior Analyticsの略。AIを利用して社内ネットワーク上のユーザーの行動やネットワークの境界における活動を学習し、通常とは異なる異常行動を検知するセキュリティツール

※4:Security Orchestration, Automation and Responseの略。脅威情報の収集と管理、インシデント対応、運用の自動化によりセキュリティ業務の効率化を図るソリューション

将来のセキュリティシステムの実現に向けた課題

将来のセキュリティシステムの実現には、課題も多くあります。国の政策面では当面デジタル化が優先され、セキュリティ対応が遅れ気味になること、人材面ではセキュリティに関して将来のビジョンや戦略を描ける人がいるか、また技術者をどのように育成するかという問題があります。技術面ではディープラーニングの精度向上やAIと人間による判断の切り分け、さらに実装面ではセキュリティベンダー各社の戦略に依存する部分が大きいこと、仕様の標準化・部品化がどこまで進むかが現時点では見えていないことなどが挙げられます(図表9)。

おわりに

ITの多様化や各国の規制強化に伴い、セキュリティリスクも今後一層、増大することが予想されます。脅威が顕在化してからの対策では重大なダメージを受ける恐れがあり、将来を見越した適切な整備計画の策定が重要になってきます。経営戦略やIT戦略という言葉はすでにおなじみでしょうが、これにセキュリティ戦略という柱を加えて一歩先んじた対応を取っていくことが、サイバーセキュリティ対策のROI(費用対効果)向上につながります。

図表10は、ベリサーブが手掛けているセキュリティ領域の一部を図示したものです。左上の囲み部分、「セキュリティ戦略策定・実行支援」が今回お話しした領域に該当し、ここから開発・保守フェーズでの技術的な診断テスト領域までをワンストップでカバーする、費用対効果の高いサービスを展開しています。

この記事をシェアする